[LG]《The Linear Centroids Hypothesis: How Deep Network Features Represent Data》T Walker, A I Humayun, R Balestriero, R Baraniuk [Rice University & Google Research & Brown University] (2026)

在深度网络可解释性研究中,"特征"究竟对应什么,始终是一个悬而未决的难题。现有主流方法——线性表征假说(LRH)——将特征定义为隐层激活空间中的线性方向,但这导致它无法区分网络真正"用到"的特征与仅仅"提取到"的虚假特征,也难以跨层追溯特征的计算来源。

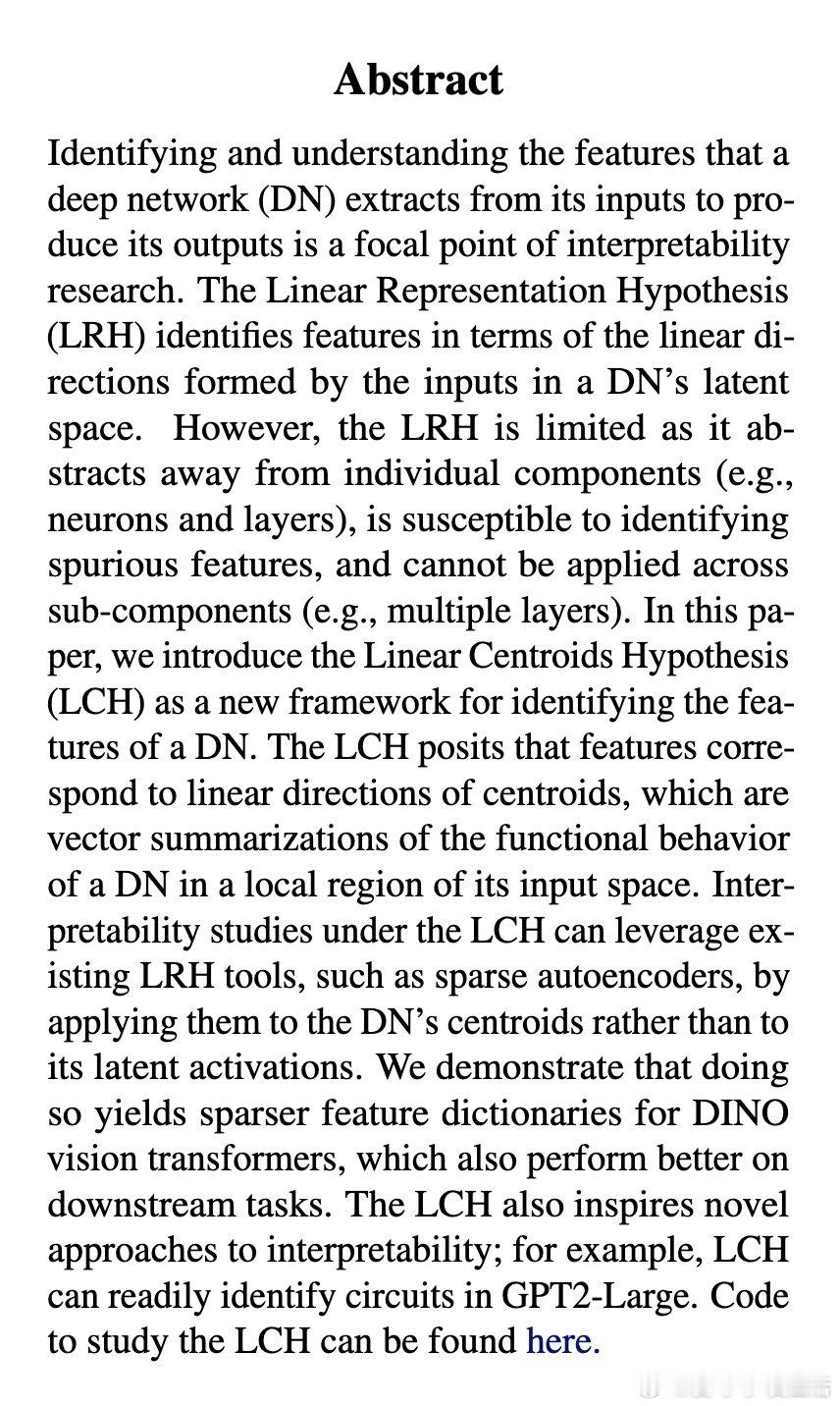

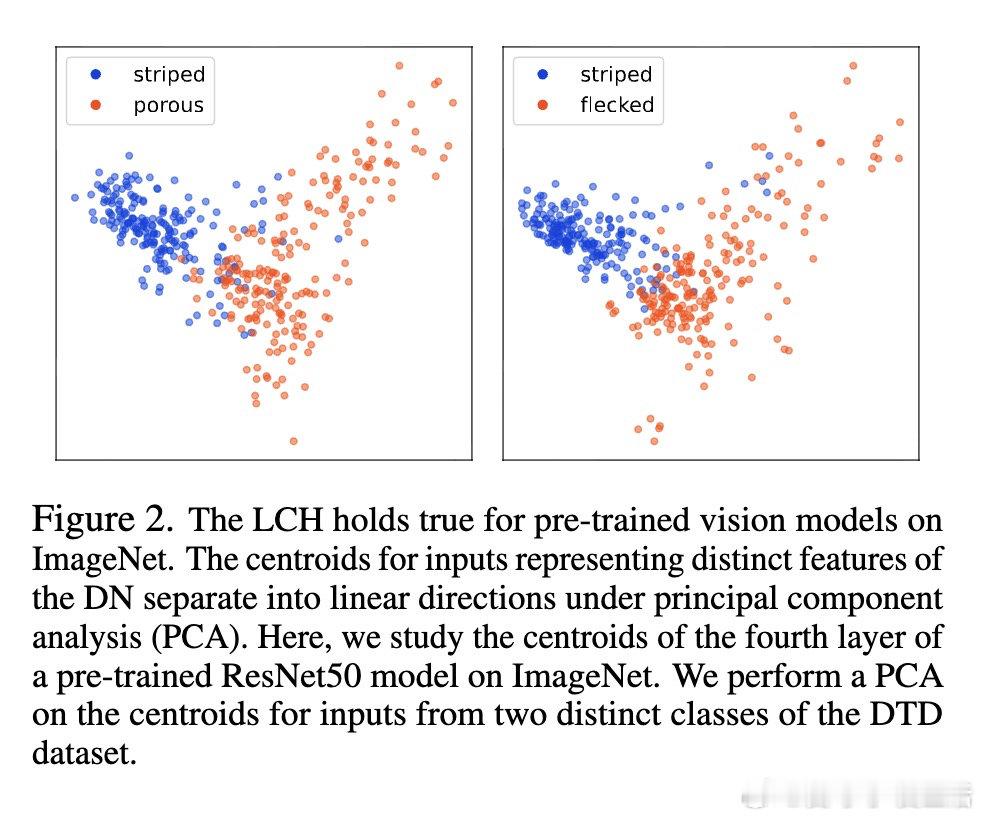

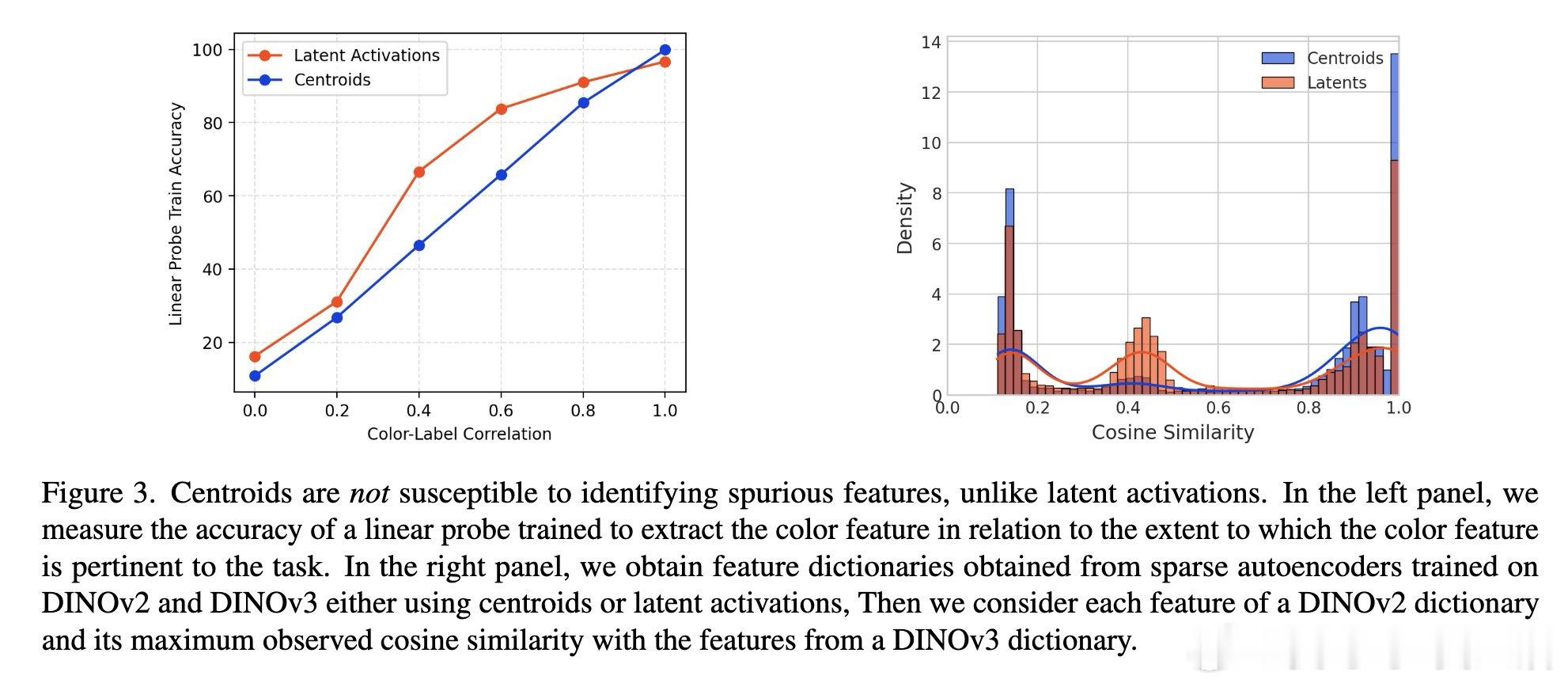

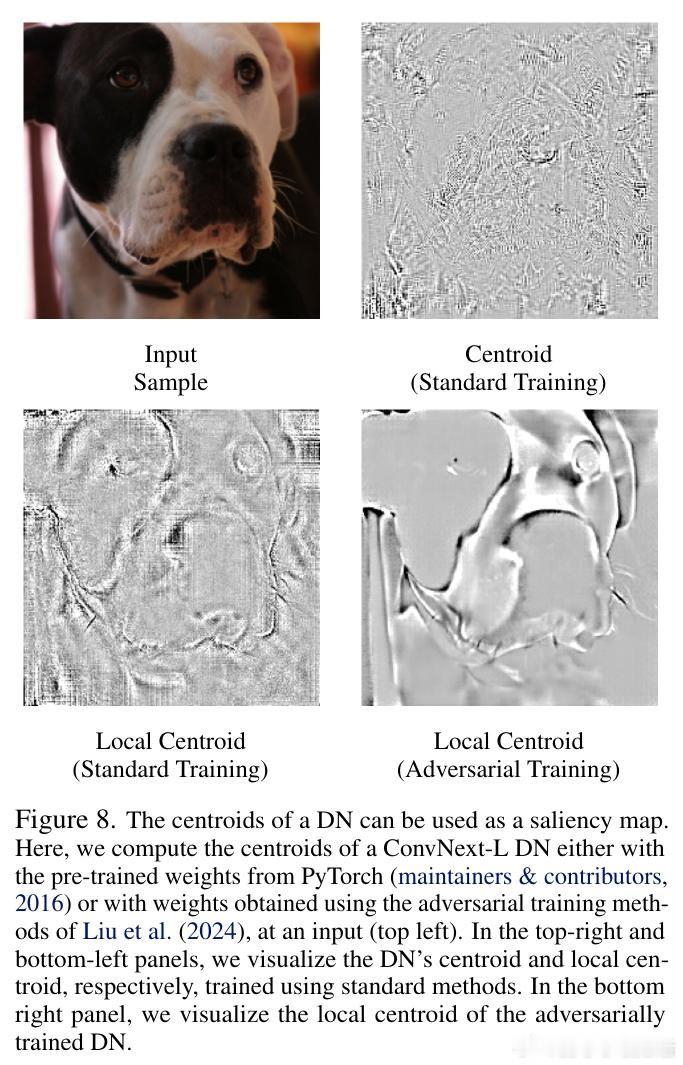

本文的核心洞见是:把"特征是什么"重新看作"局部专家如何对齐"。深度网络将输入空间划分为局部线性区域,每个区域对应一个仿射映射(专家);这些区域的质心——可由输入输出雅可比矩阵的行求和高效计算——才是特征的几何载体。由此,"质心是否形成线性方向"成为判断特征真实性的充要条件,将可解释性从事后统计转变为机制内生。

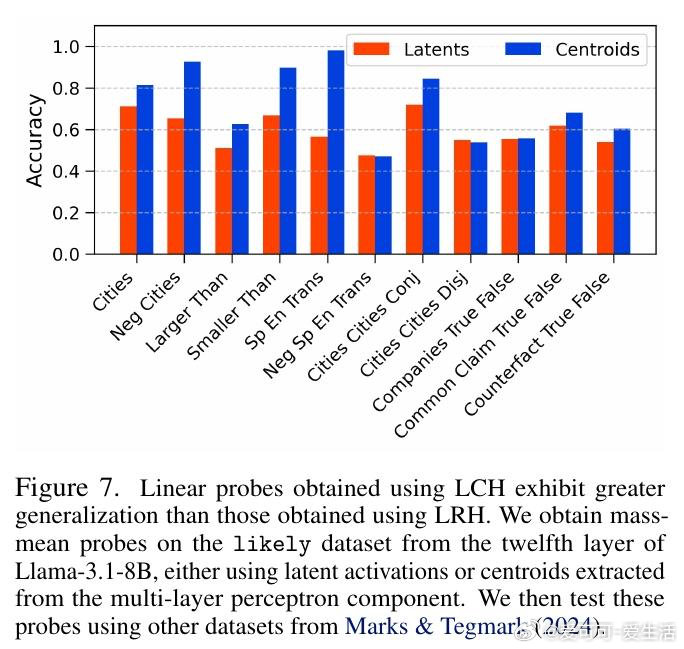

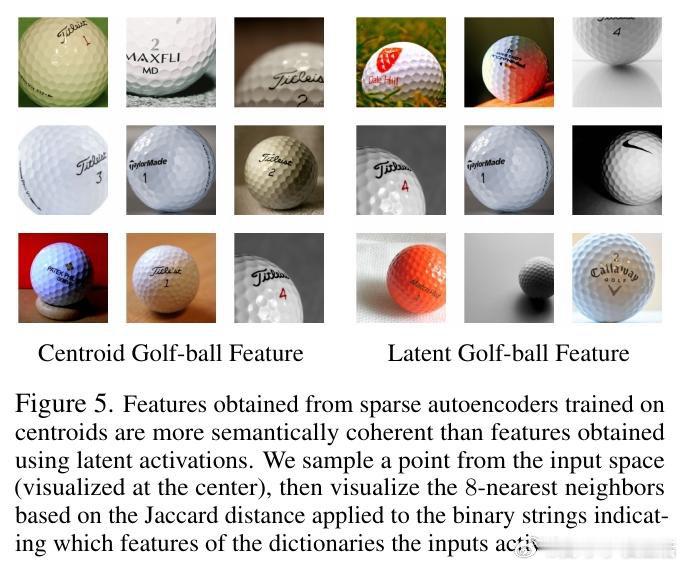

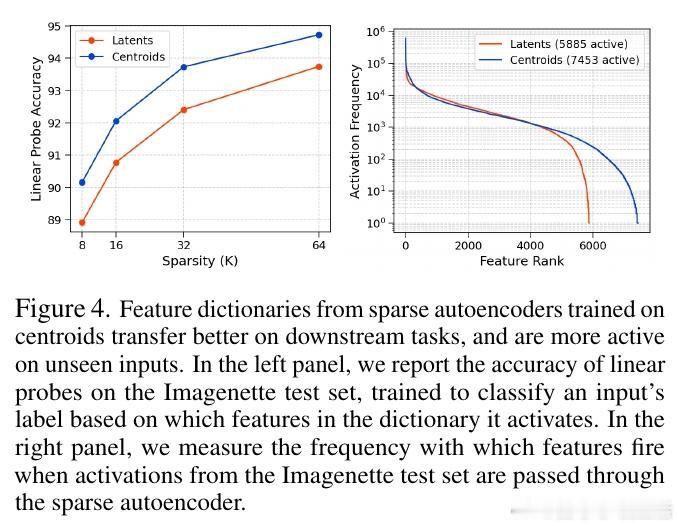

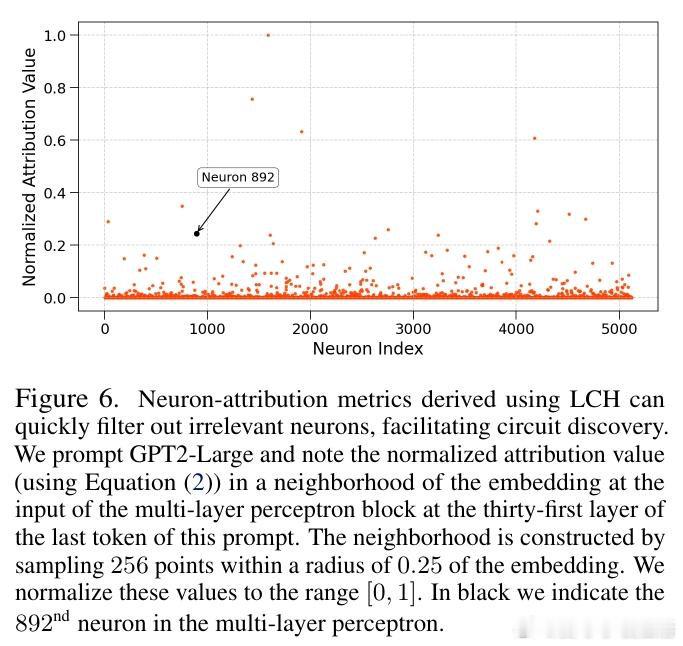

这项工作真正留下的遗产是,为特征发现提供了一个统一的几何对象:网络诱导的输入空间划分。它为后来者打开的新门是,将稀疏自编码器、线性探针、电路定位与显著性图纳入同一框架,且计算开销仅增加约10%。但尚未跨过的门槛是,功率图细分同时由质心与半径参数化,本文完全忽略了半径——而半径决定着质心是否落在自身区域内,这一维度的几何意义仍待揭示。

arxiv.org/abs/2604.11962

机器学习 人工智能 论文 AI创造营