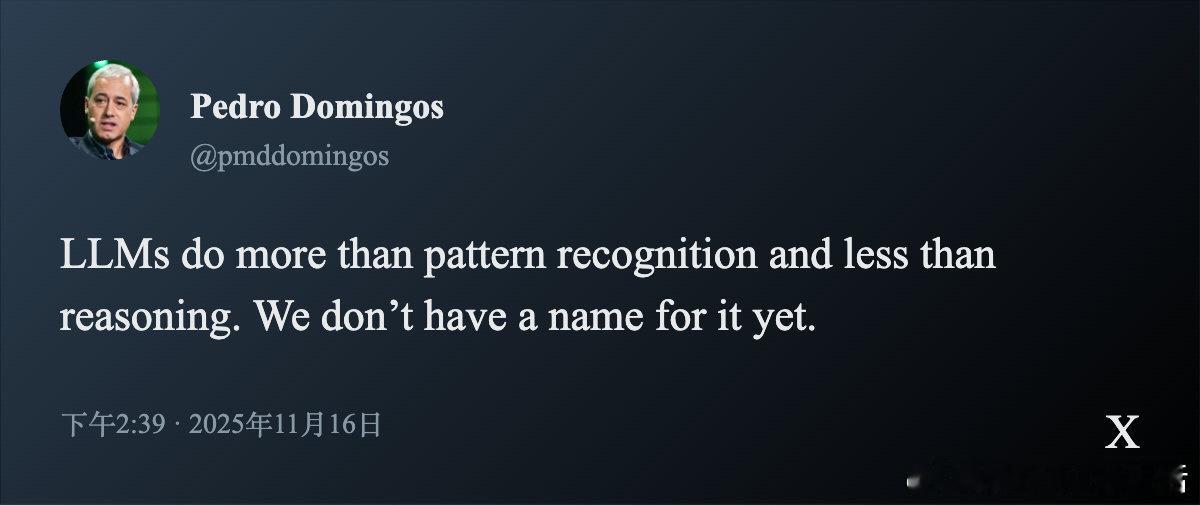

Pedro Domingos指出,大语言模型(LLM)既超越了简单的模式识别,又未达到传统意义上的推理,但我们还没有一个准确的名称来描述它们的认知能力。讨论中,有人提出“模式推理”、“模式匹配推理”、“启发式集合”、“概率联想思维”等词汇来试图界定LLM的本质;也有人认为这是一种全新的认知范式,介于机械的统计匹配和人类的多步推理之间,是“合成直觉”或“概率语义遍历”,体现了机器在大规模非结构化知识上的理解力。有观点强调,人类推理依赖于持续的记忆整合和动态脑结构更新,而当前的LLM更多依赖静态训练模式和有限的上下文记忆,缺少真正的动态学习和经验积累。但也有实际案例显示,某些LLM能够基于公式和已有知识进行自我纠错和推导,表现出某种“学习型推理”。这种新型认知既不是传统意义的推理,也不仅是简单模式匹配,而是一种跨领域、快速且经济的“类推理”能力。它挑战了我们对“思考”的定义,或许需要我们为它创造新的认知概念和术语。正如一位网友所说:“我们正在目睹一种新兴的能力,它既不完全是模式识别,也不完全是推理,而是某种尚未命名的思维形式。”这场讨论启发我们重新思考智能的本质:真正的智能不一定符合人类思维的传统框架,未来的认知工具也许会超越我们现有的语言和定义。面对快速发展的AI,我们应当保持开放的视角,警惕盲点,同时积极探索这场认知革命带来的机遇与挑战。原文:x.com/pmddomingos/status/1989946404975120639