1000块的“电子古董”反杀现代显卡?英伟达8年前神卡V100爆火!

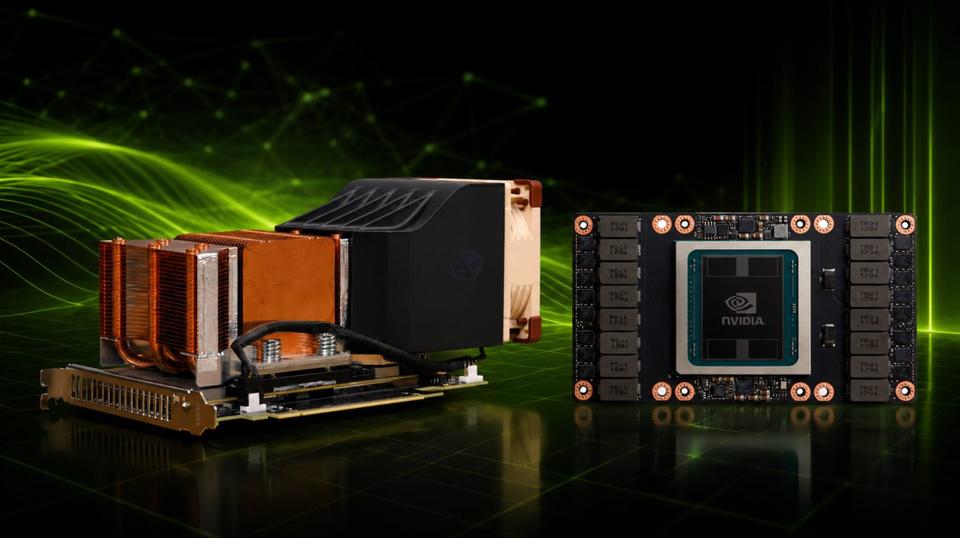

谁能想到,2017年发布的英伟达“老将” Tesla V100,最近竟然在AI圈翻红了!当年身价高达1万美元(约7万人民币)的顶级计算卡,如今在eBay上只要 100美元(约700多人民币)就能捡漏,而且它在大型语言模型(LLM)上的表现竟然能“吊打”不少现代家用显卡!

👇 核心看点:

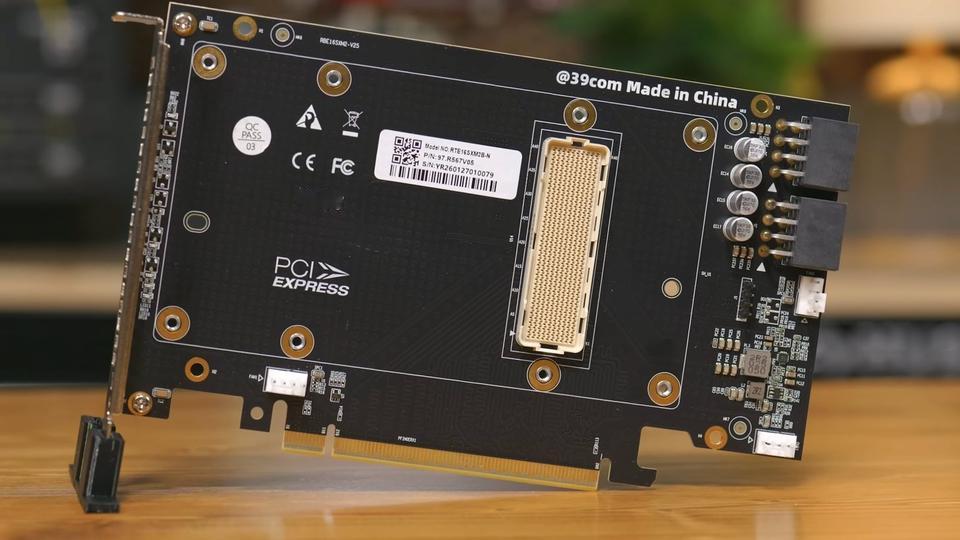

1. 性价比逆天: 博主 Hardware Haven 仅用100美元买下一块 16GB HBM2 显存的 V100(SXM2版本)。加上转接板和散热改造成的“DIY版显卡”,总成本不到200多美元,却在AI推理任务中展现了惊人的战力。

2. 实测战绩:

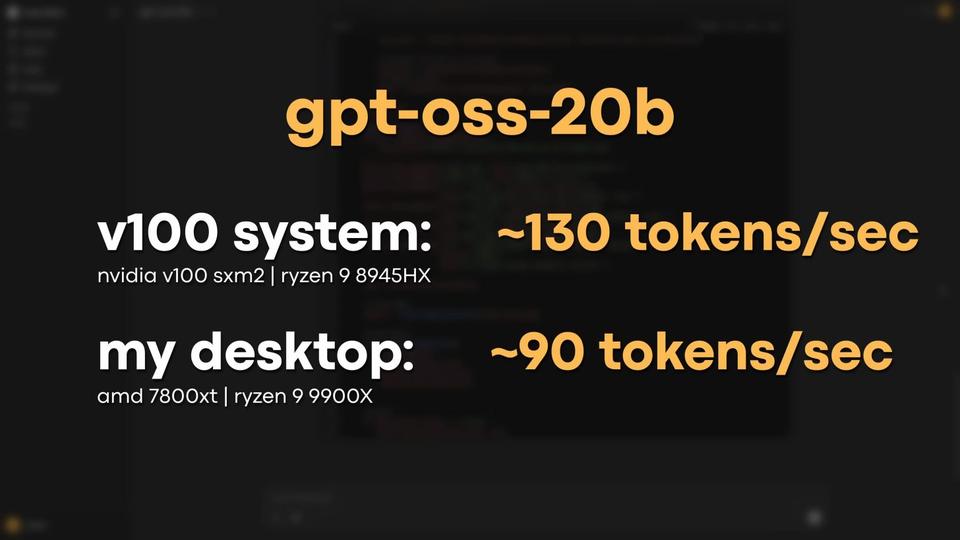

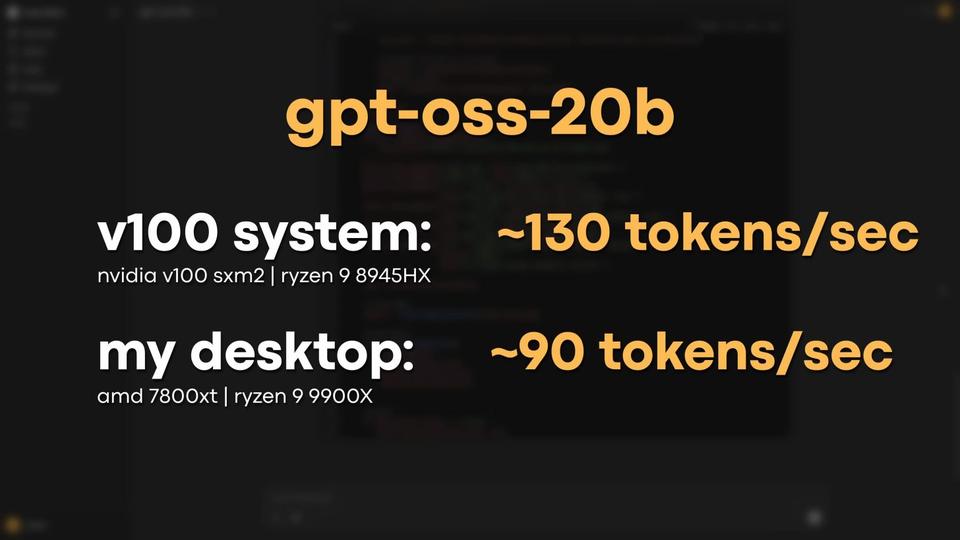

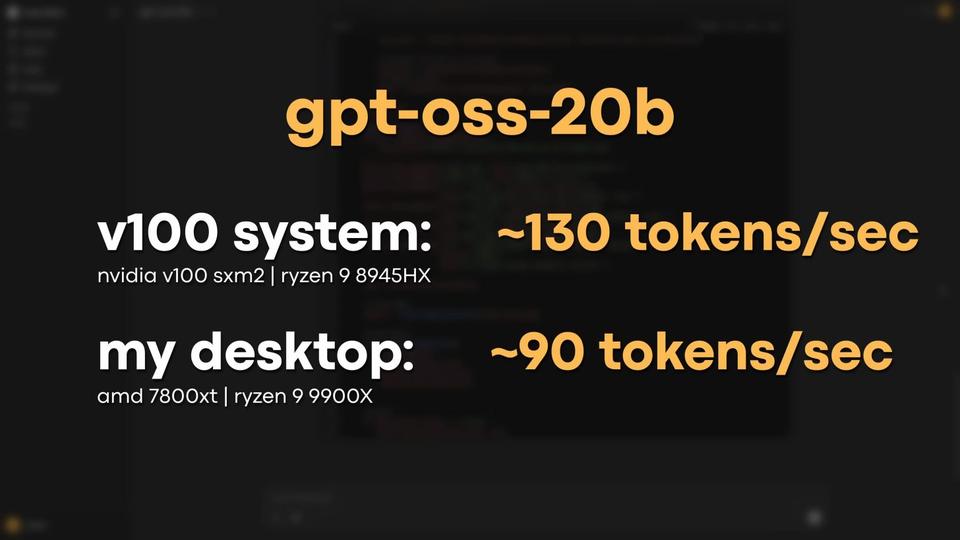

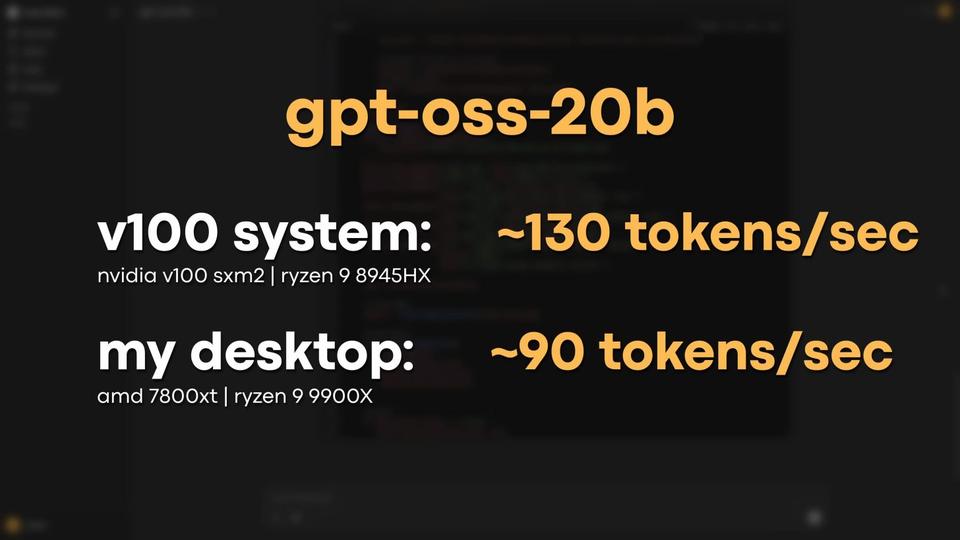

☆ 推理速度: 在运行 GPT-oss 20b 模型时,V100 每秒能输出 130个Token,直接超过了较新的 AMD RX 7800 XT(约90个Token/s)。

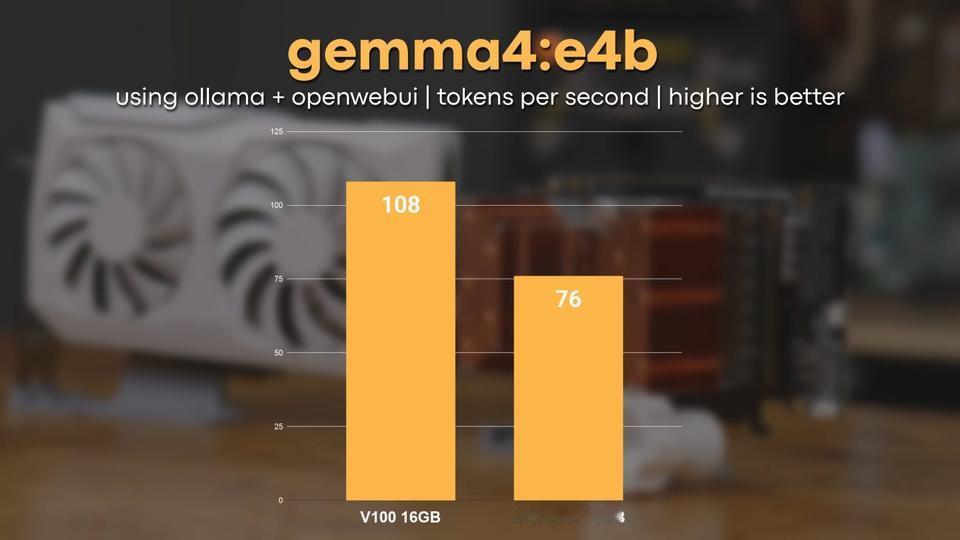

☆ 能效比: 面对 RTX 3060 12GB,V100 的生成速度领先 42%。即便是限制到100W功耗,V100 的每瓦性能依然比 3060 高出 41%。

3. 为何这么强? V100 是首款搭载 Tensor Core(张量核心) 的架构(Volta),天生就是为AI设计的。配合高带宽的 HBM2 显存,在处理LLM这类极度依赖显存带宽的任务时,优势尽显。

⚠️ 捡漏提醒(捡漏有风险):

☆ 物理兼容: 这种 SXM2 接口不能直接插电脑,需要专门的转接板(Adapter)。

☆ 散热地狱: 数据中心卡没有风扇,必须自己 3D 打印导风罩或硬改散热,否则秒变“火龙”。

☆ 驱动门槛: 这种卡现在处于“遗产驱动”支持阶段,配置起来比较折腾,适合有动手能力的“极客”玩家。

总结: 对于预算有限又想玩本地大模型的玩家来说,V100 简直是当下的“性价比之王”。看来,硬件架构的底层基因(Tensor Core + 高带宽显存)真的可以跨越8年的时光鸿沟。

你会考虑去捡漏这种“高性能古董”来跑AI吗?欢迎在评论区讨论!