说出来你可能不信,就在几个月前,当整个AI行业还在为某项测试刷分,疯狂堆砌英伟达高端显卡的时候,有一家公司,却做了一件在很多人看来像是“自断一臂”的事。

它叫DeepSeek。

它的创始人梁文锋,把团队大量的精力,从卷模型性能,转向了一个吃力不讨好的方向——全力适配咱们自己的国产芯片,比如华为的昇腾。

你想想看当时的舆论环境:一边是模型跳票、研究员流失的传闻满天飞,公司处境艰难;另一边,放着现成好用的英伟达生态不用,非要去啃国产芯片适配这块“硬骨头”,被不少人私下里认为是自寻死路。

说实话,那段时间,压力可想而知。

但现在回头看,我们可能都低估了这个决定的深意。这更像是一场目标清晰、过程艰辛的长期布局。而最终的结果,也让整个行业看到了一个新的可能。

一、 为什么说这是一场“豪赌”?因为代价真的很大

一、 为什么说这是一场“豪赌”?因为代价真的很大要理解这个决定的份量,我们得先聊聊,当时放弃的是什么。

彼时的DeepSeek,V3.2模型已经在业内站稳了脚跟。依托成熟的英伟达GPU生态,他们完全可以按部就班地迭代,用漂亮的测试成绩单,去赢得掌声和关注度。这是条捷径,无数同行都在这条路上奔跑。

但梁文锋没有。他看到的是更核心的问题:如果算力的命脉,一直挂在别人手里会怎样?一旦海外算力供应出现波动,你辛辛苦苦训练出来的模型,性能再强,也可能会像建在沙滩上的城堡,根基不稳。

于是,在最关键的研发阶段,团队调转船头,把大量资源投入了国产芯片的适配。

这份工作的难度,不是简单的“换块显卡”。千芯科技的董事长陈巍曾形容,这相当于“爬雪山、过草地”。

具体有多难呢?DeepSeek的团队需要重新优化整个模型的底层架构。他们要采用更低精度的混合精度技术,来降低对国产芯片显存和计算复杂度的压力;还要强化稀疏注意力机制,压缩KV缓存,想尽一切办法减少芯片之间大量的通信开销。

这么一来,团队大量的精力被牵扯住了,模型在性能优化上的步子,自然就慢了下来。可以说,他们是用牺牲短期行业声量、搁置快速落地优势的代价,来换取一个未来。

那段时间的内部压力,恐怕只有亲历者才能体会。研发团队连轴转是常态,反复调试参数、优化方案,目标只有一个:不仅要让模型在国产芯片上稳定运行,甚至还要实现性能的突破。

二、 从“不好用”到“加速1.96倍”,这块硬骨头是怎么啃下来的?

二、 从“不好用”到“加速1.96倍”,这块硬骨头是怎么啃下来的?功夫不负有心人。今年4月24日,DeepSeek-V4新模型发布,他们交出了一份让人印象深刻的成绩单。

根据DeepSeek发布的技术报告,V4模型在华为昇腾NPU平台上,实现了1.50至1.73倍的推理加速。在一些对延迟特别敏感的场景里,加速比最高可以达到1.96倍。

这个数字意味着什么呢?意味着“国产芯片跑不动复杂大模型”的刻板印象,被硬生生打破了。

想想看,这就好比有人告诉你,用一套自主设计的、之前被认为是“备胎”的发动机,不仅能让车跑起来,跑得比之前用进口发动机时还快、还稳。这带来的震动,是颠覆性的。

所以消息一出,整个国产芯片行业都跟着沸腾了。4月24日当天,寒武纪、摩尔线程、沐曦等相关的国产芯片公司,在资本市场上都获得了积极反馈,并且它们也同步宣布,将全量适配DeepSeek V4模型。

华为这边反应也很迅速,公开表示昇腾超节点全系列产品已全面适配,可以实现V4 Pro约20毫秒、V4 Flash约10毫秒的低时延推理。这个速度,对于追求实时交互的AI应用来说,体验是相当丝滑的。

你看,摩尔线程甚至携手相关团队,率先在自家的AI训推一体智算卡上,完成了核心算子的适配,算子通过率已超80%。

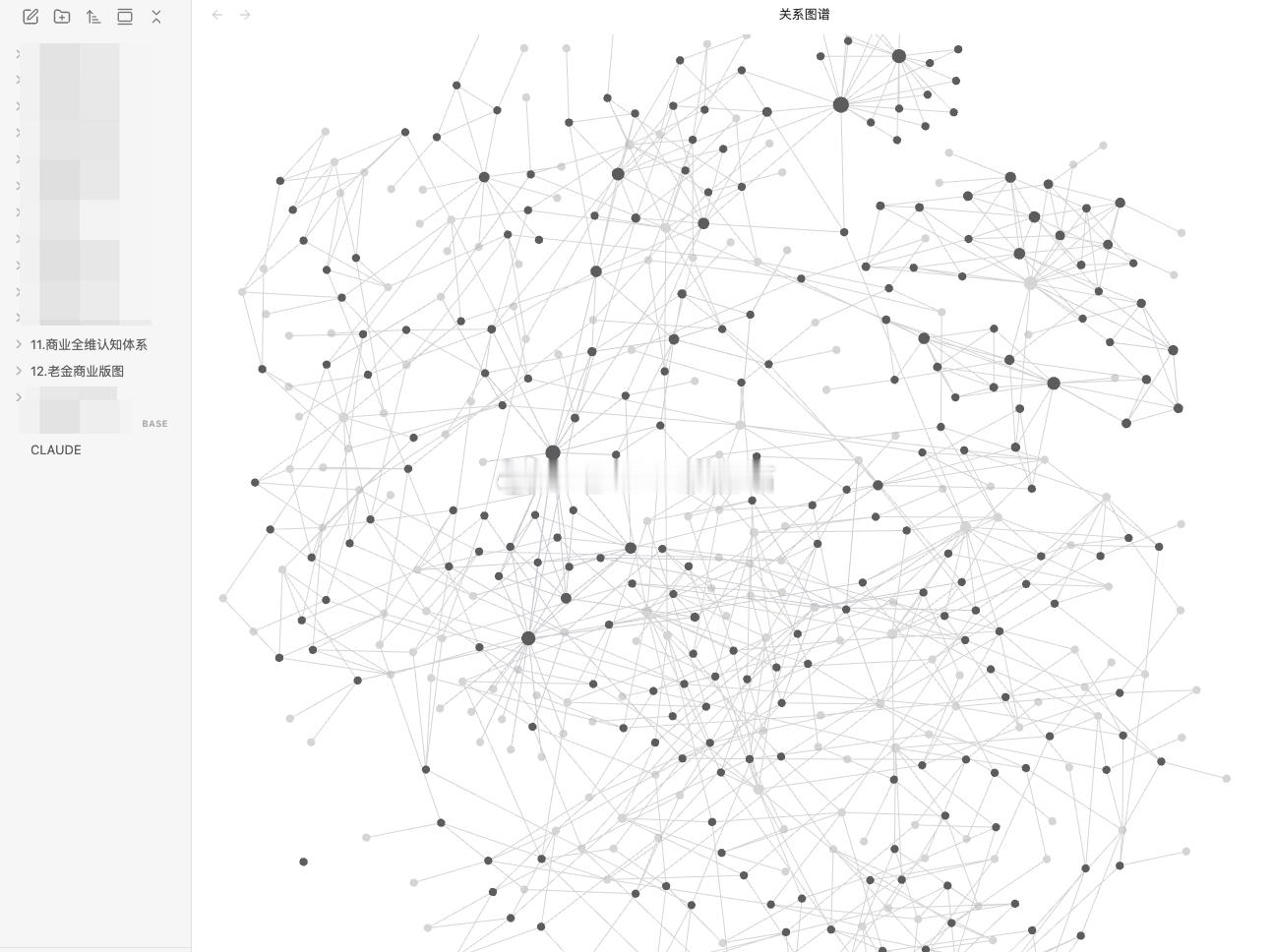

这就不再是DeepSeek一家公司的事了。它像一个关键的连接器,把我们国产模型和国产算力这两条原本还在各自探索的脉络,紧紧地“拧”在了一起,形成了一个可以实际运转的、高效的协同体系。

话说回来,这种突破,甚至让行业巨头也感受到了压力。英伟达的CEO黄仁勋,在此前的一次播客节目里就坦言,如果像DeepSeek这样的成果,是在华为的平台上先跑出来的,对美国来说会是非常糟糕的结果。

这个担忧,恰恰从侧面印证了梁文锋这一步棋的分量。

三、 技术自主带来的底气,是更合理的定价权

三、 技术自主带来的底气,是更合理的定价权如果说技术上的突破是“里子”,那随之而来的变化,则让每个人都感受到了它的实际价值。

4月26日,在V4模型发布仅两天后,DeepSeek发布了API价格调整公告,全系API输入缓存命中的价格,直接降到了首发时的十分之一。

调整后,V4 Flash每百万Tokens输入缓存命中价格仅为0.02元,面向企业级用户的V4 Pro也只要0.025元。

这个价格,用“击穿行业底价”来形容,不算是违规的极限词,而是对事实的一个客观描述。我们对比一下就知道了:同档位的其他国产模型,输出端的报价普遍是DeepSeek V4 Pro的4倍以上;更不用说很多海外模型了,定价远高于这个水平。

为什么DeepSeek能这么降?核心原因,就是前面讲到的成本优势。随着模型与国产算力的深度融合,他们不用再为高昂的海外算力成本买单,底层的算力成本结构被优化了。成本降下来了,自然就有了让利给开发者和用户的底气。

但我要特别强调的是,这并不仅仅是简单的“价格战”。我倾向于认为,这是一种基于技术实力和成本控制的“合理定价权”。

这背后的逻辑是:因为我自己掌握了核心的成本控制环节,所以我能够以一个我认为符合技术价值的、更合理的价格,去提供服务,而不必被外部成本绑架,或者跟随别人的定价体系起舞。

而且,V4系列模型本身的表现,也撑得起这个定价。它拥有百万字的超长上下文,推理性能也很领先,甚至在很多测评中击败了一些海外闭源模型。密歇根州立大学的一位教授就评价说,DeepSeek V4在数学和物理方面“又快又聪明”,结果“精致且准确”。

也就是说,梁文锋拿到的这个“定价权”,是有扎实技术和成本基础做支撑的,而不是空中楼阁。

市场也给出了最直接的回应。调价当天,V4 Flash的调用量就达到814亿Tokens,V4 Pro的调用量也有96亿Tokens。这说明,好的技术加上合理的价格,用户自然会用脚投票。

四、 一个人的增持,与一个生态的成熟

四、 一个人的增持,与一个生态的成熟就在技术和定价双双引爆舆论之后,另一个细节,也印证了梁文锋对这条路的决心。

4月27日,工商信息显示,DeepSeek的注册资本由1000万元增加至1500万元,而梁文锋的持股比例,从1%大幅提升至34%。经过调整,他通过直接和间接持股,合计控制了公司约84.29%的股权,进一步巩固了对企业的绝对控制权。

这组数据,来自九派财经的报道,是公开可查的工商变更记录。在我看来,这个动作比说任何漂亮的远景规划都更有力。它是在用最直接的方式告诉大家:这家公司的掌舵人,不仅看好这个方向,而且愿意把自己的利益和公司的未来深度绑定。

有知情人士透露,梁文锋还计划在接下来的融资中,以个人名义出资。与此同时,市场上也传出腾讯、阿里等巨头正在接触DeepSeek融资事宜的消息,估值可能超过200亿美元。

不过说真的,比起估值,我更关注的是这背后一个更深层的趋势:随着DeepSeek在国产芯片适配上的成功,我们整个的国产AI大模型产业,可能正在迈入一个新的赛段。

这个新赛段的核心竞争力,可能不再是单纯的算法创新或数据规模,而是“算力自主生态”的构建能力。

你可以想象一下这个链条:以DeepSeek为代表的模型公司,在适配过程中,为国产芯片提供了海量的、极其宝贵的工程化经验和反馈;芯片公司拿到反馈后,可以更快地迭代自己的硬件和软件生态;这些进步,又会反哺给更多的模型公司,让他们能以更低的成本、更高的效率进行研发。

这是一个正向的、自我加强的循环。它标志着,我们自己的AI产业,正在从单点的技术突破,走向产业链上下游的协同成熟。梁文锋和DeepSeek的经历,恰好为这个宏大叙事,提供了一个有血有肉的、具体而微的注脚。

梁文锋自己也曾表示,DeepSeek将始终秉持长期主义,在尝试与思考中踏实前行,努力向实现AGI(通用人工智能)的目标不断靠近。

随着国产芯片适配的不断深化,这份原本看起来有些遥远的愿景,似乎也正变得越来越清晰。

这条路,梁文锋走得很艰难,也很有担当。他放弃了一些看起来“聪明”的短期选择,用一份“笨拙”的坚持,证明了另一条路的可行性。这不仅仅是DeepSeek一家公司的胜利,它更像是一个信号,一个关于我们如何能更自信、更自主地走向AI未来的信号。

对我们普通人来说,

最大的感受就是,未来能用上的AI服务,可能会更便宜、更智能,更重要的是,它的技术根基,是牢牢扎在我们自己的土地上的。